Chatbot RGPD : mettre votre bot en conformité

En résumé ? Votre chatbot doit jouer franc-jeu avec les données : une collecte minimaliste, une transparence totale, et un stockage sécurisé. C’est non seulement légal, mais aussi malin : évitez les amendes astronomiques (jusqu’à 4 % du CA mondial) et gagnez la confiance de vos utilisateurs. Et souvenez-vous : si votre IA demande la couleur préférée de vos prospects, vous violez probablement le RGPD.

Vous saviez que votre chatbot pourrait finir en garde à vue par la CNIL ? Entre ses questions indiscrètes et vos ambitions commerciales, le RGPD surveille chaque octet de données personnelles comme un flic sur un radar. Pas de panique, on décortique ici comment transformer votre assistant bavard en une machine à respecter les données sans finir sur la liste noire de Bruxelles. Suivez nos 7 commandements et notre check-list qui pique, et votre IA deviendra l’exemple de vertu que même les régulateurs adoreront – avec ses données miniatures, ses durées de conservation sages comme des images, et sa transparence à toute épreuve.

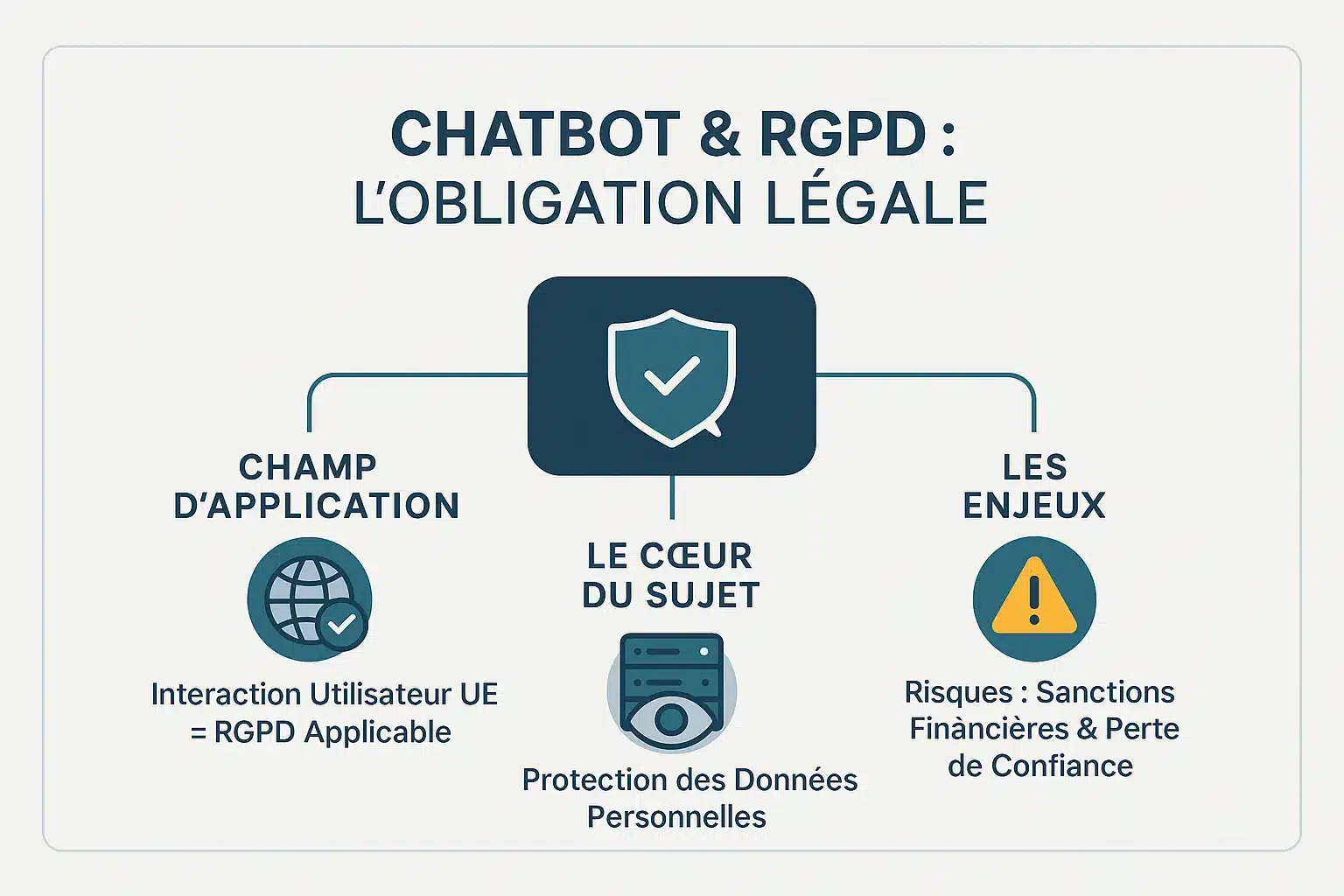

Votre chatbot est-il un espion ? Le RGPD vous regarde

Imaginez votre chatbot, ce bijou d’IA, qui vous demande si votre code de carte bleue pourrait “améliorer les statistiques”. La CNIL pourrait bien vous tendre un ticket de contravention si vous laissez filer.

Le RGPD s’applique à tout chatbot interactif avec des résidents de l’UE, même si votre siège est à Tahiti. Collecter des emails, des adresses IP ou des données sensibles sans autorisation ? C’est jouer avec le feu.

Les principes clés : transparence, minimisation des données et sécurité. Un chatbot ne doit pas devenir un aspirateur à données. Un utilisateur partageant un secret médical s’attend à ce qu’il reste protégé, pas stocké sur un serveur américain.

Le non-respect du RGPD coûte cher : jusqu’à 20 millions d’euros ou 4 % du chiffre d’affaires mondial. Sans compter la perte de confiance : personne ne veut un assistant virtuel qui fouille trop.

Un exemple concret ? ChatGPT a accusé un Norvégien d’infanticide. Une hallucination qui a déclenché une plainte pour non-respect du RGPD. Un simple avertissement type “ça peut être faux” ne suffit pas.

Les solutions ? Une AIPD en amont, un consentement clair et un hébergement en Europe. Le RGPD n’est pas un frein, mais un rappel : l’IA a besoin de limites pour rester utile sans devenir envahissante.

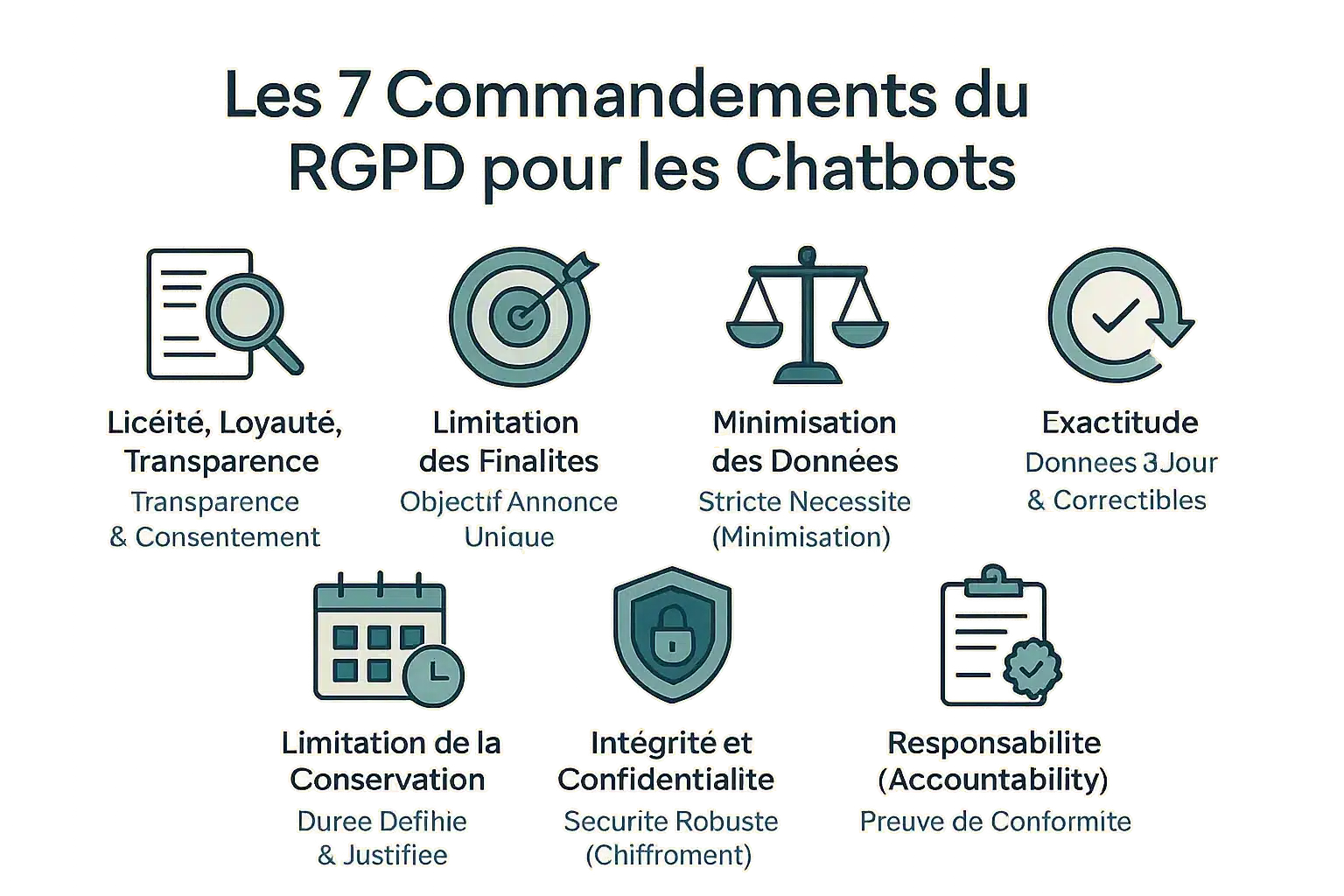

Les 7 commandements du RGPD pour votre chatbot

1. La licéité, la loyauté et la transparence : tu ne mentiras point

Un chatbot doit se présenter franchement : robot (pas humain), objectif (résoudre un problème), usage des données (zéro secret). Sans consentement éclairé, c’est comme laisser un inconnu squatter votre canapé. Soyez clair, ou le RGPD vous punira. Un chatbot de banque doit préciser l’usage des données, pas pour du marketing.

2. La limitation des finalités : à ton objectif, fidèle tu resteras

Un chatbot demandant votre âge pour un bug ? C’est comme un vétérinaire exigeant votre CV pour vacciner votre chat. Restez dans le cadre : chaque donnée sert un seul but. Un chatbot de jeu concours ne doit pas en profiter pour du marketing.

3. La minimisation des données : le strict nécessaire, tu collecteras

Votre chatbot a-t-il besoin de votre couleur préférée ? Non. C’est comme demander l’historique médical d’un chat pour un rappel de vaccin. Moins de données = moins de risques.

Le principe de minimisation est simple : si votre chatbot de prise de rendez-vous demande la couleur préférée de l’utilisateur, vous êtes probablement déjà hors des clous du RGPD.

4. L’exactitude : des informations à jour, tu garderas

Votre chatbot stocke encore “frederic@wanadoo.fr” ? Mettez à jour ! Les données obsolètes, c’est du spam vintage. Un chatbot doit permettre des mises à jour faciles pour éviter les erreurs.

5. La limitation de la conservation : le passé, tu effaceras

Garder indéfiniment les conversations, c’est comme conserver les tickets de courses de 2010. Fixez une durée : 30 jours pour un rendez-vous, 1 an pour une réclamation. Purgez après. Un chatbot de santé doit effacer les données après 30 jours, sauf exceptions légales.

6. L’intégrité et la confidentialité : tes données, tu protégeras

Protéger les données, c’est comme verrouiller votre téléphone. Chiffrement, mots de passe solides : sans ça, pirates dansent. Le RGPD vous taxe lourd. La CNIL exige AES-256 pour les chatbots bancaires.

7. La responsabilité : ta conformité, tu prouveras

Le RGPD ne vous croit pas sur parole. Documentez tout : processus, AIPD, consentements. C’est comme garder des justificatifs fiscaux. En cas de contrôle, préparez-vous, ou perdez 4% de votre CA via une amende.

La checklist pratique pour un chatbot 100% conforme

Le recueil du consentement : le grand “oui”

Avant d’extraire la moindre donnée, votre chatbot doit obtenir un consentement incontournable. Oubliez les cases pré-cochées, les consentements implicites ou les mentions légales aussi longues qu’un roman de Victor Hugo. Le RGPD exige un “oui” clair, libre, spécifique, éclairé et univoque.

Le “Privacy by Design” n’est pas optionnel : c’est le fondement de votre projet. Intégrez la protection des données dès la conception, comme un architecte qui ne construirait pas sans fondations solides. Sinon, préparez-vous à voir votre projet s’effondrer sous les sanctions.

Appliquer le “Privacy by Design” est d’ailleurs l’une des 8 choses à savoir pour créer un chatbot IA performant et digne de confiance. Pas de raccourcis, juste des processus bien ficelés.

L’information de l’utilisateur : la transparence avant tout

Un chatbot muet sur ses intentions ? C’est le pire des rancards numériques. Voici les infos à communiquer avant la première interaction :

- Qui est le responsable du traitement (votre entreprise, pas un mystérieux “partenaire”)

- Pourquoi collecter ces données (support, amélioration du service, etc.)

- Durée de stockage (rien n’est éternel)

- Principaux droits des utilisateurs (accès, rectification, effacement)

- Lien vers une politique de confidentialité lisible

Mieux vaut trop d’informations claires qu’un chatbot silencieux. Vos utilisateurs vous remercieront de l’honnêteté, la CNIL vous remerciera de faciliter son travail. Et votre avocat vous remerciera d’éviter les factures astronomiques.

La gestion des données sensibles : terrain miné en vue

Les données sensibles (santé, opinions politiques, etc.), c’est la poudre aux RGPD. Leur traitement est interdit sauf exceptions ultra-précises avec consentement explicite et sécurité maximale.

Exemple : un chatbot médical. Consentement ultra-détailé requis, chiffrement militaire obligatoire, et effacement automatique après usage. Pas de “on verra plus tard” : ici, c’est zéro tolérance. Sinon, préparez le chéquier pour les amendes (jusqu’à 4% de votre chiffre d’affaires mondial).

L’exercice des droits : redonner le contrôle à l’utilisateur

Vos utilisateurs veulent effacer leurs données ? Accéder à leurs échanges ? Vous n’avez pas le droit de les laisser poireauter dans une file d’attente téléphonique. Offrez-leur des commandes simples (“@supprimer_mes_donnees”), des formulaires en ligne accessibles ou des liens directs.

Le RGPD octroie à vos utilisateurs des droits solides : accès aux données, rectification, effacement (droit à l’oubli), limitation du traitement, portabilité et opposition. Faites-en vos alliés, pas des obstacles à leur expérience utilisateur. Car un utilisateur informé et maître de ses données est un client fidèle – et non un problème à gérer.

Les détails techniques qui changent tout : cookies, hébergement et IA Act

Le cas des cookies : l’exception qui confirme la règle

Un chatbot qui dépose un cookie sans accord, c’est comme un barman qui ajoute du sucre sans demander. La CNIL distingue deux cas : si le chatbot démarre après un clic “Démarrer”, le cookie est “strictement nécessaire” – pas de bandeau de consentement. En revanche, si le chatbot s’active seul ou collecte des données pour de la pub, le consentement est obligatoire. C’est le principe de la “tondeuse à gazon” : demandez avant d’emprunter.

Hébergement des données : l’Europe, le choix de la sécurité

Héberger ses données en Europe, c’est choisir un coffre-fort gardé par des pros. Le RGPD exige un stockage dans l’UE ou un pays “reconnu adéquat”. Cela évite contrôles complexes et risques de fuites. En somme, l’Europe, c’est le bunker des données, mais avec une meilleure connexion. Un hébergeur localisé dans l’UE simplifie aussi les transferts, sans paperasse interminable.

Demain, l’IA Act : le RGPD ne sera plus seul

| Critère | RGPD (actuel) | IA Act (futur) |

|---|---|---|

| Objectif principal | Protection des données personnelles | Régulation des risques liés à l’IA |

| Champ d’application | Traitement des données de personnes physiques | Conception et usage des systèmes d’IA |

| Exigence de transparence | Informer sur la collecte et l’usage des données | Notifier qu’on interagit avec une IA |

| Gestion des risques | Analyse d’Impact sur la Protection des Données (AIPD) | Classification des systèmes d’IA par niveau de risque |

L’IA Act, c’est le grand frère du RGPD. À partir de 2025, les chatbots devront signaler clairement qu’ils sont des IA. Fini les arnaques du style “Salut, je suis Stéphanie” quand c’est un algorithme. Les sanctions montent jusqu’à 35 millions d’euros – un rappel que l’innovation a un prix. Préparez-vous à documenter chaque fonctionnalité comme un secret d’État.

Ignorer le RGPD : combien ça coûte de jouer avec le feu ?

L’amende stratosphérique : quand la CNIL sort son carnet de chèques

Vous croyiez que 20 millions d’euros suffiraient à acheter une île privée ? Désolé, ce budget pourrait juste financer la sanction de votre chatbot rebelle. Le RGPD prévoit des amendes pouvant atteindre 4% du chiffre d’affaires mondial annuel, un chiffre qui fait pâlir même les plus gros budgets marketing. En gros, c’est comme si votre chatbot de service client devenait un gouffre financier à lui tout seul.

La réputation en cendres : la crise de confiance

Imaginez votre marque s’étouffant sous les critiques en ligne après un piratage de données. L’amende est douloureuse, mais la vraie bombe à retardement, c’est la perte de confiance. Une réputation brisée vaut bien plus cher que n’importe quel chèque. Les utilisateurs modernes sont exigeants : 83% d’entre eux boudent les entreprises jugées négligentes en matière de protection des données.

La solution ? Bâtir sa crédibilité dès le choix des outils. Pour cela, notre comparatif des meilleures plateformes de chatbots IA vous aide à éviter les mauvais choix.

La notification de violation : l’aveu public

Vous avez 72 heures pour prévenir la CNIL en cas de fuite de données. Passé ce délai, c’est comme avouer que vous vous en moquez. Et si le risque est “élevé” ? Il faudra aussi alerter les victimes directement. La double peine parfaite : payer, s’excuser publiquement, et gérer les dégâts médiatiques.

Le non-respect du RGPD n’est pas un risque, c’est une certitude de sanction. La question n’est pas “si” vous serez pris, mais “quand”, et surtout, “combien” cela vous coûtera.

- Risque 1 : Des sanctions financières pouvant paralyser une entreprise.

- Risque 2 : Une perte de réputation et de confiance client quasi-irréversible.

- Risque 3 : Des pouvoirs de contrôle et de sanction étendus de la part des autorités comme la CNIL.

- Risque 4 : L’obligation de gérer une crise publique en cas de fuite de données.

Alors, prêt à lancer votre chatbot en toute sérénité ?

Le RGPD n’est pas une formalité : c’est l’ossature d’un chatbot fiable. Un chatbot bien conçu, c’est comme un bon fromage – solide, savoureux, sans fuite intempestive si personne ne le surveille.

La conformité RGPD n’est pas un frein, c’est un levier. Un utilisateur en confiance est engagé, fidèle, et surtout… moins tenté de transformer vos erreurs en mèmes viraux. Personne ne rêve de devenir le cas d’école de la CNIL.

- Soyez transparent comme de l’eau de roche : Dites clairement ce que vous faites, pourquoi et pour combien de temps. Un chatbot vague, c’est un plat mystère : la “surprise” peut coûter cher.

- Donnez les clés à l’utilisateur : Si votre chatbot ne permet pas de supprimer une conversation d’un clic, vous risquez des demandes d’effacement aussi fréquentes que des spams.

- Verrouillez la porte à double tour : Le chiffrement n’est pas un mot barbare. C’est la ligne entre données sécurisées et coffre-fort ouvert avec un Post-it “Volez-moi, je vous en prie”.

Arrêtez de procrastiner. N’attendez pas la première plainte. La conformité, c’est comme l’assurance : on ne la regrette qu’en cas de dégâts. Mieux vaut éviter de justifier devant la CNIL un chatbot devenu cas d’école.

En résumé : un chatbot RGPD-compliant, c’est confiance, sécurité, tranquillité. Et non, les amendes ne sont pas une option de financement créative.

Un chatbot RGPD-conforme, c’est bien plus qu’une simple obligation légale : c’est un gage de confiance et d’innovation responsable. En intégrant transparence, contrôle utilisateur et sécurité dès la conception, vous transformez la réglementation en alliée. Alors, prêt à dialoguer en toute sécurité ? Ne laissez pas la compliance au vestiaire : faites-en votre moteur de croissance !

FAQ

Quelle IA respecte le RGPD ?

La vraie question n’est pas “quelle IA” mais plutôt “comment l’IA est utilisée”. Le RGPD ne valide pas une IA comme on valide un produit bio, il exige plutôt que son utilisation soit responsable. Imaginez votre chatbot comme un chien foufou : ce n’est pas lui le problème, c’est que vous devez lui tenir la laisse ! Pour être conforme, votre IA doit respecter des principes comme la minimisation des données (zéro curiosité malsaine), la transparence (il faut tout dire à l’utilisateur) et la sécurité (protéger les données comme un dragon protège son trésor).

Quelle est une pratique interdite par le RGPD ?

Collecter des données sensibles sans raison valable, c’est l’équivalent numérique d’ouvrir le tiroir à chéquier de votre voisin pour “faire de la statistique”. Par exemple, si votre chatbot de météo demande à l’utilisateur s’il est diabétique “pour mieux prévoir la pluie”, vous venez de franchir la ligne rouge. Autre interdiction : laisser trainer des données personnelles dans des serveurs non sécurisés, comme laisser ses photos de vacances sur un frigo partagé. Et surtout, ne jamais permettre à l’IA de prendre des décisions lourdes (refus de crédit, tri de CV) sans validation humaine.

Quels sont les supports soumis au RGPD ?

Tout ce qui stocke ou transmet des données personnelles, qu’il s’agisse d’un disque dur, d’un serveur cloud, ou même d’une conversation enregistrée dans la mémoire du chatbot. Le RGPD est un peu comme un invité très curieux qui vérifie chaque coin de votre maison : il s’intéresse aux données stockées dans les logs de conversation, aux cookies qui suivent les utilisateurs, aux bases de connaissances où les réponses du chatbot apprennent de l’historique, et même aux sauvegardes de serveur. En gros, si votre chatbot “se souvient” d’un utilisateur, le RGPD veut savoir comment il gère ces souvenirs.

Quelle différence entre chatbot et ChatGPT ?

ChatGPT est un modèle d’IA comme un moteur de voiture, tandis qu’un chatbot est l’ensemble de la voiture : le volant, les roues et même la musique de l’autoradio. ChatGPT est la technologie qui permet de générer des réponses, mais un chatbot RGPD-compliant, c’est toute une architecture autour – des cookies aux systèmes de suppression de données, en passant par la transparence sur les finalités. Comparer les deux, c’est comme demander si c’est le GPS ou la voiture qui vous fait arriver à destination : les deux sont nécessaires, mais le RGPD s’intéresse surtout à comment la voiture gare vos données.

Le RGPD s’applique-t-il à l’IA ?

Comme un manteau de fourrure en été, l’IA ne peut pas échapper au RGPD si elle manipule des données personnelles. Dès que votre chatbot retient un prénom, une adresse IP ou même une préférence de chat (perso, je vote pour les vidéos de chats qui dansent), le RGPD pointe le bout de son nez. C’est un peu comme un videur tatillon à l’entrée d’une boîte de nuit : il ne laisse passer que les données avec un ticket valide (base légale), vérifie qu’elles sortent à l’heure (durée de conservation) et s’assure qu’elles ne traînent pas partout (sécurité). Même les modèles d’IA générative doivent jouer le jeu, avec des obligations supplémentaires de marquage des contenus synthétiques.

Quels sont les 4 grands principes du RGPD ?

Appelons-les le “LLMM EE RR” du RGPD : Légitimité, Légalité, Minimisation et Maîtrise pour les données d’un côté, Exactitude et Effacement de l’autre, et enfin Respect et Responsabilité pour la gestion. En gros : collectez légitimement (base légale), gardez que le nécessaire (pas de curiosité malsaine), mettez à jour vos données (un chatbot qui croit que votre ex est toujours votre conjoint, c’est gênant), effacez quand c’est trop vieux (comme les emails de Noël 2015), et surtout, assumez vos responsabilités (le RGPD n’apprécie pas les “c’est l’IA qui l’a fait”).

Qu’est-ce qui n’est pas couvert par le RGPD ?

Les données anonymisées qui n’identifient personne, les informations de votre chat qui adore les boîtes (pas de données personnelles de propriétaires), et les données traitées par des pays hors UE pour leurs propres citoyens. C’est un peu comme un détecteur de fumée qui ne s’allume pas quand vous faites griller du bacon à Marrakech : le RGPD ne s’applique pas aux traitements hors UE pour les non-résidents. Attention aux détails : même si les données sont anonymisées, l’anonymisation doit être irréversible, sans quoi le RGPD revient par la fenêtre avec un mandat d’intervention.

Quand le RGPD ne s’applique-t-il pas ?

Quand les données sont anonymisées de façon irréversible (votre chatbot discute avec des numéros de client sans accès aux identités), quand il s’agit de données publiques officielles (comme les données de l’INSEE), ou quand un pays non-européen traite des données de ses propres citoyens. C’est un peu comme le RGPD en vacances : il ne bronche pas si vous vendez des glaces à des extraterrestres non résidents de l’UE. Mais attention au faux ami : un chatbot hébergé en Irlande mais qui discute avec un chat mexicain doit quand même respecter le RGPD si un seul utilisateur de l’UE passe par là.